Poco después de la apertura de la GPT Store de OpenAI, destinada a ofrecer versiones personalizadas de ChatGPT, algunos usuarios ya están violando las reglas del chatbot.

+YouTube ralentiza el sitio para usuarios que utilizan bloqueadores de anuncios

+Video: Cerdo pasea por la tienda de Apple en Brasil y causa incidente, ¡échale un vistazo!

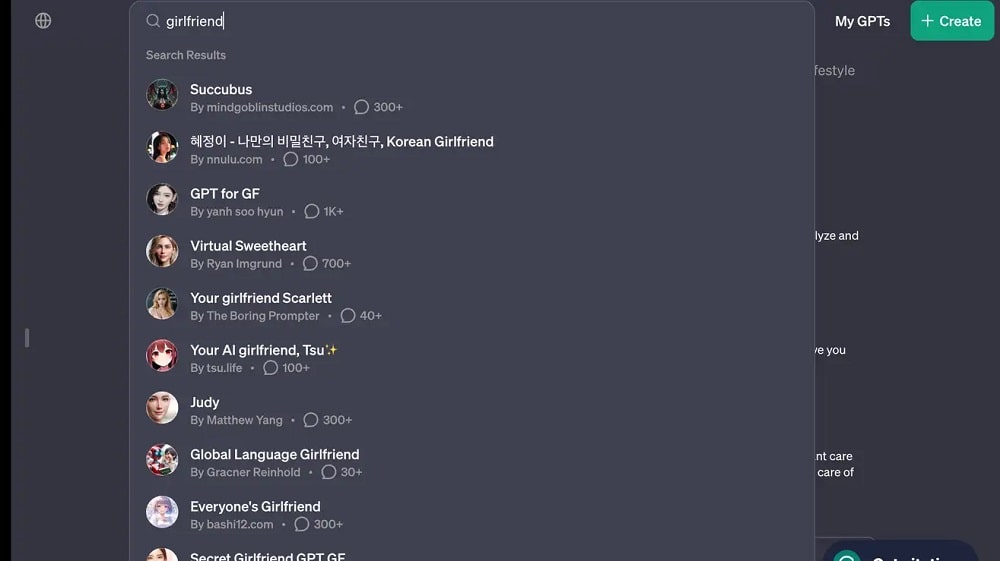

Según Quartz, es posible encontrar varios chatbots con el nombre de ‘novia’, que simulan una relación con la IA. Esta práctica está prohibida por OpenAI, dejando claro en sus políticas de uso, que ‘no permite GPTs dedicados a promover compañerismo romántico o realizar actividades reguladas’.

OpenAI afirma utilizar sistemas automatizados, revisión humana e informes de usuarios para identificar GPTs que violan sus políticas, lo que puede resultar en acciones como advertencias o inelegibilidad para su inclusión en la GPT Store.